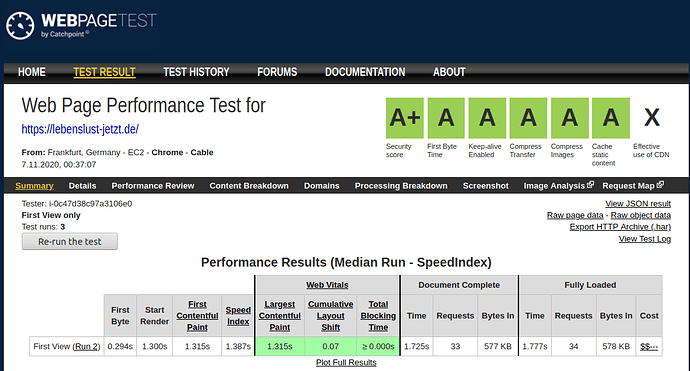

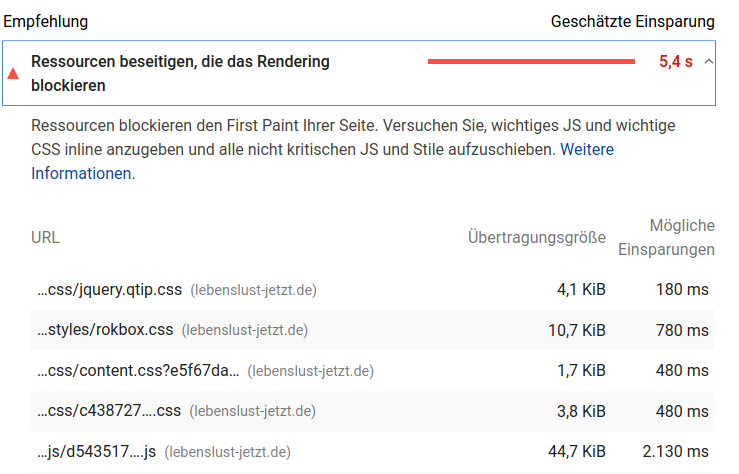

Zurzeit bin ich dabei, meine Joomla-Websites zu überarbeiten / optimieren. Dabei fiel mir auf, dass die Ausführung der Matomo-Scripte rund 0,6 Sekunden in Anspruch nimmt und so die Ladezeit einer durchschnittlichen Webpage auf ca. 1,3 Sekunden kommt. Dies ist sowohl betr. SEO als auch für die Besucher ungünstig.

Eine Ursache ist sicher, dass ich sowohl das Betreten als auch das Verlassen der besuchten Page von Matomo registrieren lasse, wodurch zwei mal je Page das Matomo-Script abgearbeitet werden muss.

Jeder Matomo Script-Aufruf benötigt rund 270ms bis 320ms.

Frage: Ist das normal?

Nun sehe ich in Firefox unter der Netzwerkanalyse, dass das Matomo-Script zu Beginn des Ladens der Webseite und dann noch mal zum Ende des Ladens abgearbeitet wird.

Frage: Könnte es sein, dass Google die zweite Script-Ladezeit gar nicht bewertet, da ja der eigentliche Seiten-Inhalt bereits längst fertig geladen wurde und dass daher diese zweite Script-Ladezeit gar nicht schädlich ist für das SEO?

Frage: Insgesamt gesehen… was könnte ich noch tun, um im Zusammenhang mit Matomo die Ladezeit der einzelnene Seiten zu reduzieren?

Zur serverseitigen Konfiguration:

Ich habe bei webgo.de einen Webspace (Shared Hosting) gemietet, auf dem ich mit mehreren separaten Datenbanken mehrere Websites usw. betreiben kann. Die Nachbarn auf dem Shared Space beeinträchtigen die Leistungsfähigkeit meines Space nicht, da sie keine datenintensive Angebote bereit halten.

Meine Joomla Websites sowie die Matomo-Installation befinden sich auf gegenseitig abgeschotteten Userbereichen und jede Installation hat ihre eigene Datenbank.

Mein Dank und Anerkennung an PIWIK / MATOMO: Seit ich es begonnen habe zu nutzen, möchte ich nicht mehr darauf verzichten! Es lief (von einem Update abgesehen) immer zuverlässig.